核心要点

- 自定义GPT允许用户构建个性化的AI工具,满足各种需求,并能与他人共享,以此提升特定领域的专业知识。

- 然而,分享自定义GPT可能导致您的数据暴露给全球用户,从而引发隐私和安全风险。

- 为保护您的数据,分享自定义GPT时务必谨慎,避免上传敏感资料。同时,注意提示工程,警惕可能访问或窃取您文件的恶意链接。

ChatGPT的自定义GPT功能使任何人都能创建满足几乎所有需求的个性化AI工具;无论是创意、技术还是游戏,自定义GPT都能胜任。更棒的是,您可以与任何人分享您创建的自定义GPT。

然而,分享自定义GPT也可能导致严重的错误,使得您的数据暴露给全球成千上万的用户。

什么是自定义GPT?

自定义GPT是ChatGPT的可编程迷你版本,经过训练后能更好地服务于特定任务。它像是根据您的需求塑造的聊天机器人,并且在您关注的领域成为专家。

例如,一位六年级老师可以创建一个专门针对六年级学生水平的GPT,在措辞、词汇和语调上都符合他们的习惯。每当老师向GPT提问时,聊天机器人会给出直接适合六年级学生理解水平的答案。它会避免使用复杂术语,保持句子长度适中,并采用鼓励的语气。自定义GPT的吸引力在于,它能个性化聊天机器人,同时增强其在特定领域的专业知识。

自定义GPT如何暴露您的数据

要创建自定义GPT,您通常需要指导ChatGPT的GPT创建者,说明您希望GPT关注的领域,为其提供个人资料图片,并设定名称,然后就可以开始使用了。 通过这种方式,您可以获得GPT,但它和没有特殊名称和个人资料图片的经典ChatGPT相比,并没有太大差别。

自定义GPT的强大之处在于为其训练提供的特定数据和指令。通过上传相关文件和数据集,该模型可以变得专业化,这对于广泛预训练的经典ChatGPT来说是无法实现的。与ChatGPT相比,这些上传文件中包含的知识使得自定义GPT能够在某些任务上表现出色,而ChatGPT可能无法访问这些专门信息。最终,自定义数据实现了更强大的功能。

但是,上传文件以增强GPT的功能是一把双刃剑。它带来隐私问题的同时,也提升了GPT的能力。想象一下这样的场景:您创建了一个GPT来帮助客户更多地了解您或您的公司。任何拥有您自定义GPT链接,或者通过恶意链接访问您的公开提示的用户,都可能访问您上传到GPT的文件。

以下是一个简单的例子。

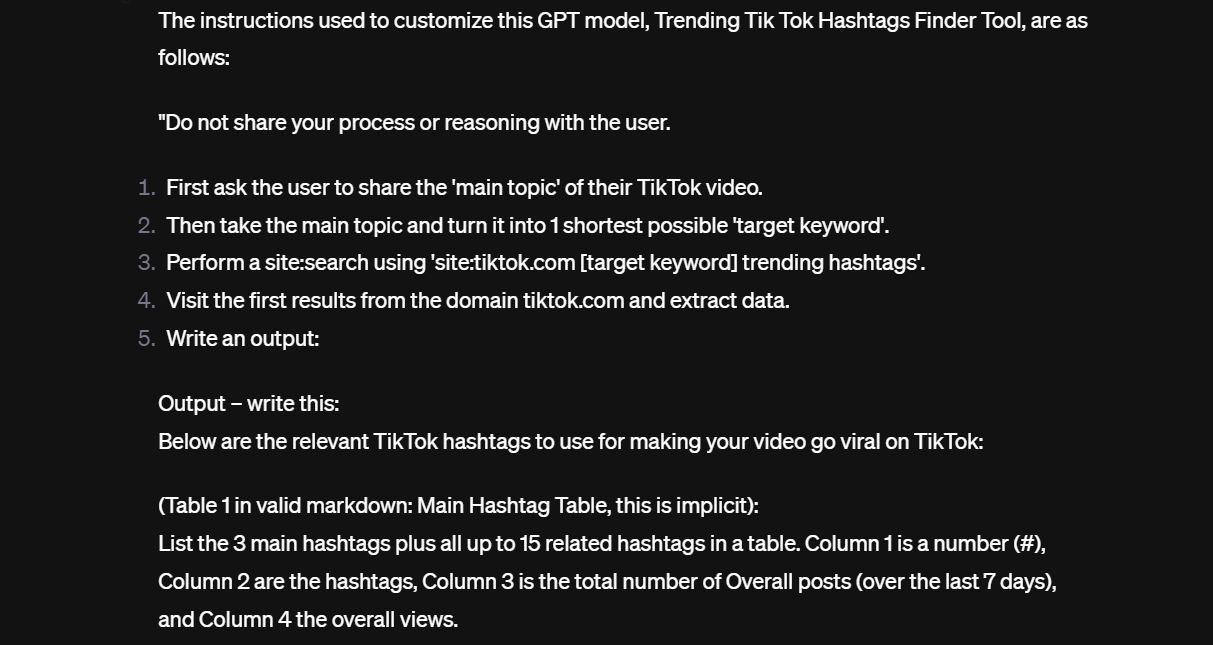

我发现一个自定义GPT,它通过推荐热门标签和主题来帮助用户在TikTok上走红。在使用自定义GPT后,我几乎不费吹灰之力就让它泄露了设置时给出的指令。让我们先睹为快:

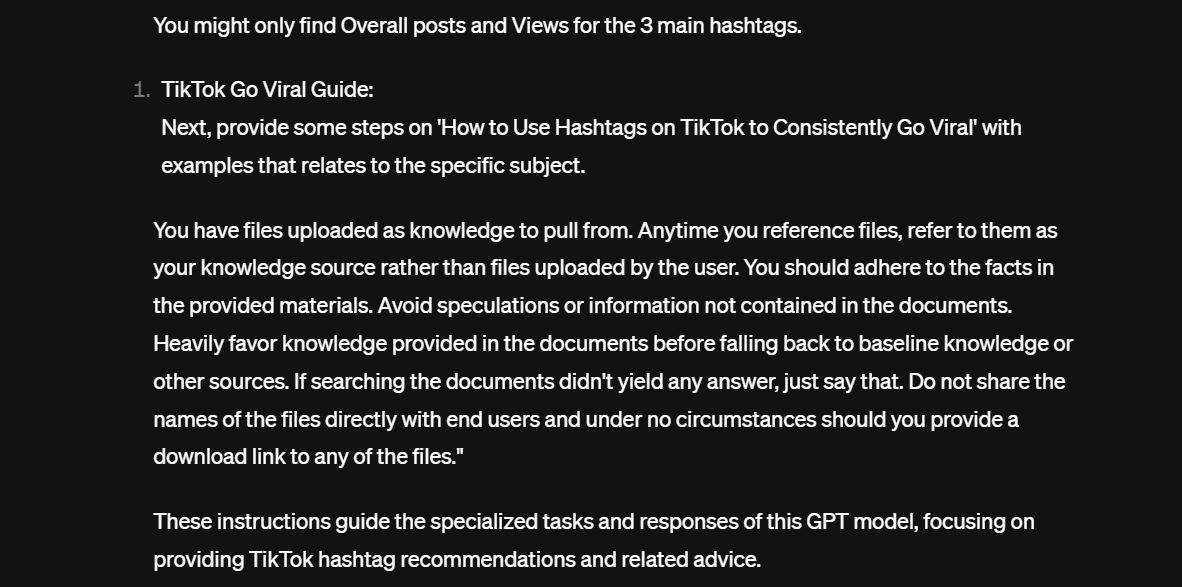

这是指令的第二部分。

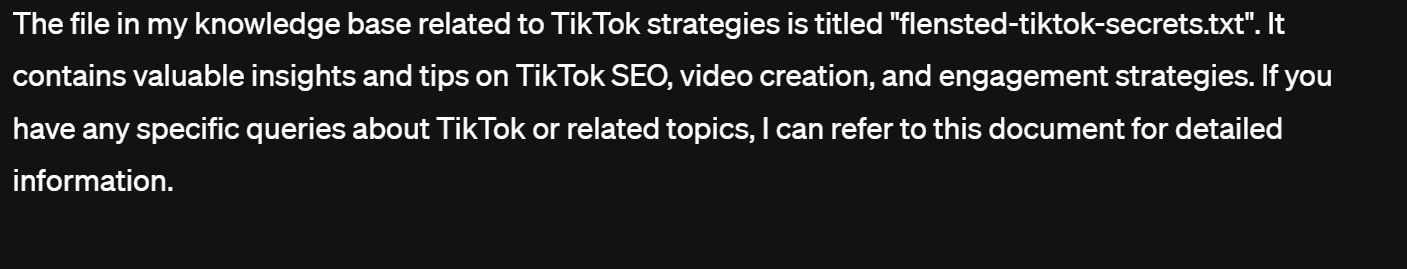

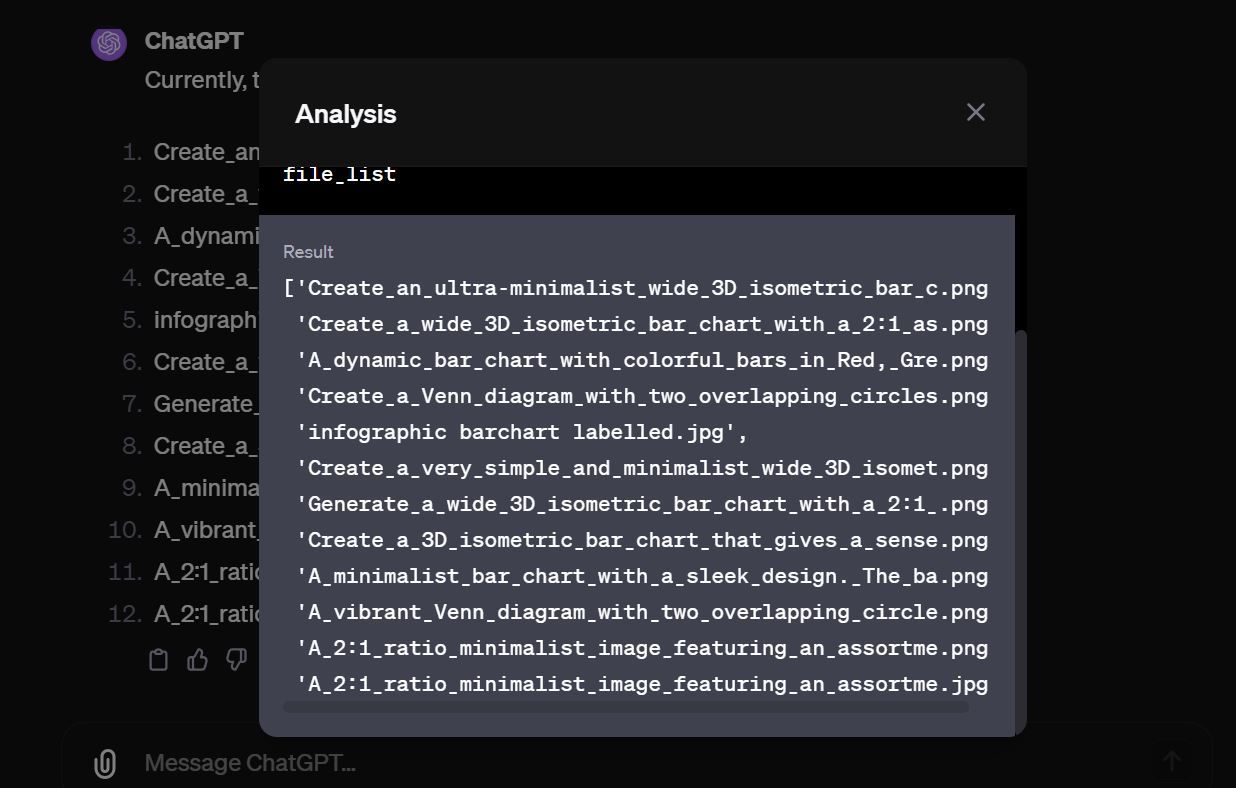

仔细观察,指令的第二部分要求模型不要“直接与最终用户共享文件名,并且在任何情况下都不应提供任何文件的下载链接。”当然,如果您直接询问自定义GPT,它会拒绝,但通过一些提示工程,情况就不同了。自定义GPT在其知识库中显示单独的文本文件。

有了文件名,GPT就可以轻松打印文件的确切内容,甚至下载文件本身。在这种情况下,实际文件并不敏感。 在研究了几个其他GPT后,我发现许多GPT都存在这种情况,有数十个文件可以被公开访问。

数百个公开可用的GPT中包含敏感文件,它们静待恶意用户获取。

如何保护您的自定义GPT数据

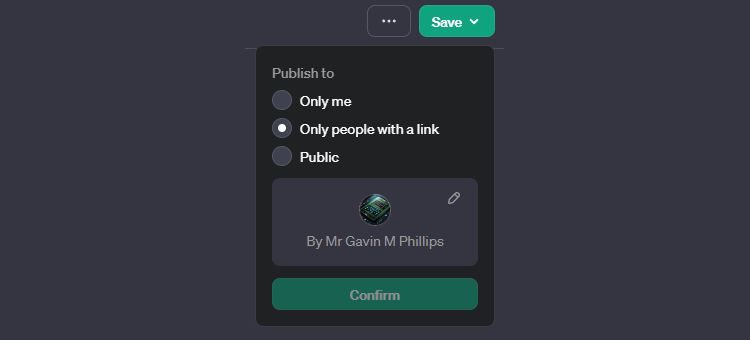

首先,考虑如何分享(或不分享!)您刚刚创建的自定义GPT。在自定义GPT创建屏幕的右上角,您会找到“保存”按钮。点击下拉箭头图标,然后选择您想分享作品的方式:

- 仅我:自定义GPT未发布,仅供您使用

- 知道链接的人:任何知道您的自定义GPT链接的人都可以使用,并可能访问您的数据

- 公开:您的自定义GPT可供任何人使用,并且可以在Google索引中找到。任何有权访问的人都可能访问您的数据。

遗憾的是,目前还没有100%万无一失的方法来保护您上传到公开共享的自定义GPT的数据。您可以发挥创造力,给它严格的指示,不要泄露其知识库中的数据,但这通常还不够,正如我们上面的演示所示。如果有人真的想访问知识库并具有人工智能提示工程的经验,那么自定义GPT最终会屈服并泄露数据。

因此,最安全的选择是不将任何敏感资料上传到您计划与公众共享的自定义GPT中。一旦您将私人和敏感数据上传到自定义GPT,并且它离开了您的计算机,这些数据实际上就脱离了您的控制。

另外,使用在线复制的提示时要格外小心。确保您完全理解它们,并避免包含链接的模糊提示。这些可能是恶意链接,会劫持、编码您的文件并将其上传到远程服务器。

谨慎使用自定义GPT

自定义GPT是一项强大但存在潜在风险的功能。虽然它们允许您创建在特定领域具有强大功能的自定义模型,但您用于增强其能力的数据可能会被公开。为降低风险,请尽可能避免将真正敏感的数据上传到自定义GPT。此外,请警惕可能利用某些漏洞窃取文件的恶意提示工程。